a cura di

Francesco Spadera, Project Manager, Consulente, Formatore Twin Transition

Marco Cibien, ICIM Consulting

Prosegue in questo numero l’approfondito escursus dedicato alla prima norma internazionale che definisce i requisiti per un sistema di gestione dell’Intelligenza Artificiale, sviluppata per promuovere una gestione etica e responsabile dei ‘sistemi AI’. La prima parte dell’articolo è disponibile nel magazine inGRUPPO di gennaio 2026 a questo LINK

AIMS: le peculiarità e l’ecosistema

Oltre a quanto visto in precedenza, l’AIMS presenta altri elementi aggiuntivi (add-on) rispetto alla struttura HS e anche alla “sorella maggiore” ISO/IEC 27001 (ISMS – Information Security Management System). In sintesi:

- Finalità previste dei sistemi AI e ruolo dell’organizzazione: l’analisi di contesto (punto 4.1) prevede espressamente la determinazione di tutti i sistemi AI dell’organizzazione, comprese le relative finalità previste (intended purpose) e la definizione del ruolo dell’organizzazione rispetto a essi (e.g. produttore, fornitore di servizi AI-specific, integratore, utilizzatore). Alla luce del continuo sviluppo in termini di architetture dei modelli AI, nuovi ambiti di applicazione e casi d’uso (use cases), nonché dei ruoli – spesso ibridi e variabili, nel tempo e da sistema a sistema – che l’organizzazione può assumere, la questione è spesso meno banale di quanto sembri e comunque soggetta a dinamiche di cambiamento non trascurabili.

- Cultura e approccio responsabile verso i sistemi AI: benché tali aspetti siano formalmente citati solo in note nel corpo norma (punti 4.1 e 5.1), sono da considerarsi asset organizzativi chiave a livello di contesto interno e leadership. Non a caso, essi sono ripresi in alcuni dei controlli di base previsti dalla norma e rappresentano dei fattori abilitanti per la cosiddetta AI literacy, ossia quell’insieme di conoscenze, abilità e comportamenti attesi necessari a una gestione consapevole e strutturata dall’AI.

- Analisi degli impatti (Impact Assessment): come già visto (cfr. Prospetto 1), uno degli elementi distintivi dell’AIMS è il potenziamento del processo di valutazione del rischio, che trova particolare riscontro nei punti 6.1 e 8 della norma e nel processo di analisi degli impatti (Impact Assessment). Quest’ultimo si configura come add-on anche rispetto all’ISMS e implica la capacità organizzativa di valutare le potenziali conseguenze per singole persone o gruppi, fino alla società nel suo complesso, derivanti dallo sviluppo, fornitura e utilizzo dei sistemi AI.

Un’ulteriore menzione merita, infine, l’Appendice C (informativa), che fornisce una guida per correlare gli obiettivi organizzativi correlati all’AI (e.g. disponibilità di dati per l’addestramento / validazione / valutazione, manutenibilità, privacy, trasparenza e spiegabilità) ad alcune tipiche fonti di rischio di settore (e.g. livello di automazione, problemi e limitazioni hardware, gestione del ciclo di vita dei sistemi AI, livello di maturità tecnologica).

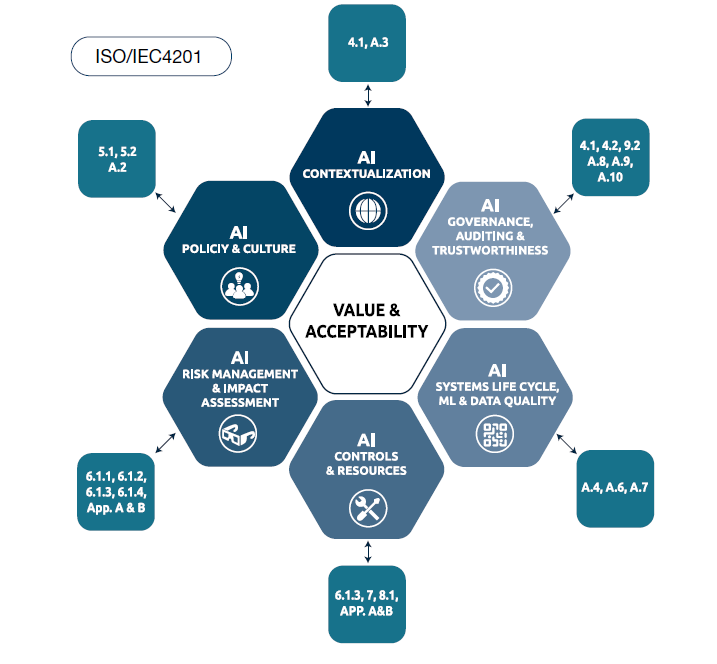

Alla luce dell’insieme di considerazioni proposte, emerge un ultimo centrale aspetto, ossia che, per la corretta comprensione e applicazione di un AIMS, la ISO/IEC 42001 è condizione necessaria ma ragionevolmente non sufficiente. In altre parole, in funzione dello specifico contesto, livello di ambizione e grado di maturità dell’organizzazione nella gestione dei sistemi AI, è opportuno – per non dire indispensabile – integrare la suddetta norma con un insieme di altri riferimenti tecnico-normativi ISO/IEC che forniscono un insieme coerente di requisiti e linee guida su aspetti (topics) verticali in ambito AI.

In definitiva, la ISO/IEC 42001 è il fulcro dal quale intraprendere un percorso progressivo e virtuoso di crescita, orientato a una gestione strutturata, etica e responsabile dei sistemi AI. Per questo motivo, si può parlare, a rigore, di:

- ecosistema ISO/IEC in ambito AI, per identificare l’insieme, in continua evoluzione, di riferimenti di settore applicabili;

- approccio tecnico-normativo integrato, per indicare la capacità, individuale e organizzativa, di identificare e integrare le disposizioni dei suddetti riferimenti nel proprio AIMS, in maniera rigorosa, ponderata e – perché no! – creativa.

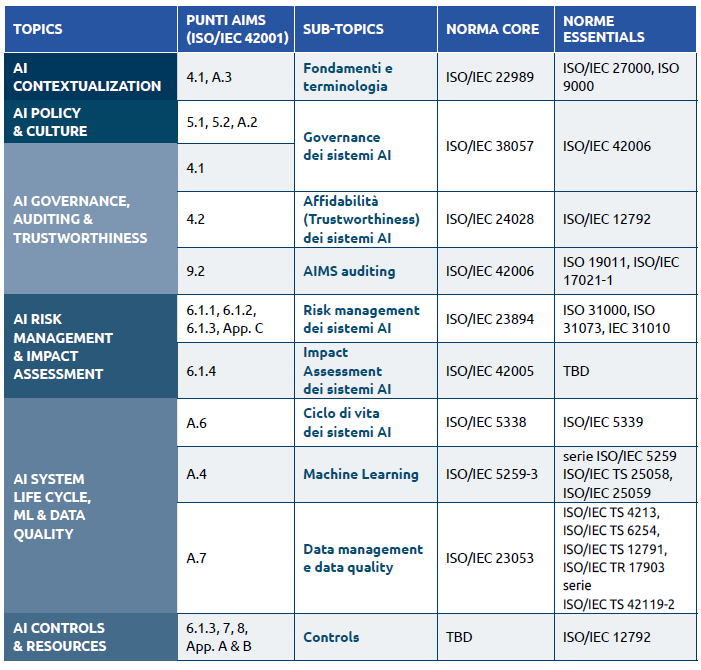

Il seguente Prospetto 1 riporta, in termini non esaustivi, i principali riferimenti dell’ecosistema ISO/IEC e i relativi aspetti correlati, in continuità con le peculiarità e gli add-on analizzati in precedenza.

Prospetto 1 – Ecosistema ISO/IEC di riferimento per l’AIMS

AIMS e AI-ACT: scenari e considerazioni

Il quadro delineato nei paragrafi precedenti evidenzia come la ISO/IEC 42001 non possa essere letta né applicata in modo isolato, ma debba necessariamente essere collocata all’interno di un più ampio ecosistema tecnico-normativo. Ciò è però vero anche dal punto di vista legislativo-regolatorio e, in questo caso, il Regolamento (UE) 2024/1689 sull’Intelligenza Artificiale (i.e. AI-Act) rappresenta oggi il principale riferimento giuridico vincolante a livello europeo.

L’interazione tra AIMS e AI-Act non è lineare né priva di punti interrogativi. Piuttosto, essa si configura come un altro percorso di progressiva – e a tratti tortuosa – convergenza – dato che si tratta di due strumenti diversi per natura, finalità e meccanismi di funzionamento: da un lato una norma tecnica volontaria, certificabile e basata su un approccio sistemico e di miglioramento continuo; dall’altro un regolamento cogente, fondato su una logica prescrittiva e su una classificazione del rischio di tipo prevalentemente ex ante.

Una prima sostanziale distinzione riguarda l’oggetto dell’intervento. L’AI-Act adotta un approccio product- and use-case oriented, concentrandosi sui singoli sistemi AI, sulle loro finalità d’uso e sui rischi associati a specifiche applicazioni (i.e. vietate, ad alto rischio, a rischio limitato o minimo). L’AIMS, viceversa, opera a livello organizzativo, mirando a strutturare processi, responsabilità, controlli e processi decisionali che governano l’intero ciclo di vita dei sistemi AI, indipendentemente dalla loro specifica classificazione e contesto legislativo-regolatorio.

Ne consegue che la conformità all’AI-Act non può essere automaticamente assicurata dall’adozione di un AIMS, così come l’implementazione di un AIMS non esaurisce, né intende esaurire, gli obblighi di compliance previsti dal Regolamento. Tuttavia, è altrettanto evidente che un sistema di gestione dell’AI ben progettato costituisce un potente abilitatore organizzativo per affrontare in modo strutturato e sostenibile gli adempimenti normativi.

Un secondo elemento di riflessione riguarda la diversa concezione del rischio. L’AI-Act introduce una “tassonomia rigida“, basata su categorie predefinite e su requisiti puntuali, che risponde all’esigenza del legislatore di tutelare diritti e interessi pubblici fondamentali, specificamente in materia di sicurezza e privacy. L’AIMS, coerentemente con la tradizione dei sistemi di gestione ISO, adotta invece una visione dinamica e contestuale del rischio, fondata sulla valutazione continua, sulla proporzionalità delle misure e sull’integrazione con gli indirizzi strategici dell’organizzazione.

Proprio per questo, l’AIMS consente di gestire non solo il down-side del rischio, i.e. la prevenzione e mitigazione degli impatti negativi, ma anche di creare le condizioni per una governance responsabile dell’innovazione, capace di adattarsi all’evoluzione tecnologica e normativa. Tale caratteristica appare particolarmente rilevante in un contesto, come quello dell’AI, caratterizzato da rapidi cambiamenti e da un’elevata incertezza applicativa.

Quindi, pur nella loro eterogeneità, AIMS e AI-Act possono essere letti come strumenti complementari. L’AI-Act definisce il cosa deve essere rispettato in termini di requisiti minimi, obblighi e divieti. l’AIMS fornisce invece indicazioni sul come strutturare processi e controlli interni per assicurare, nel breve, medio e lungo termine, un utilizzo dell’AI coerente con principi di responsabilità, trasparenza e affidabilità.

In questo quadro si inserisce anche la Legge 132/2025, che, pur senza introdurre un sistema di requisiti tecnici paragonabile a quello del Regolamento Europeo, esplicita l’orientamento del legislatore nazionale verso una governance dell’AI fondata su responsabilità organizzativa, presidio dei processi decisionali e tutela degli impatti sociali ed economici. La norma italiana, nel ribadire il ruolo delle organizzazioni quali soggetti attivi nella gestione dei rischi connessi all’AI, rafforza indirettamente la rilevanza di strumenti volontari come l’AIMS, capaci di tradurre tali principi in assetti operativi verificabili.

In tale ottica, l’adozione di un AIMS può facilitare:

- l’identificazione e la tracciabilità dei sistemi AI rilevanti ai fini dell’AI-Act e della normativa nazionale;

- la gestione documentata delle valutazioni del rischio e degli impatti, anche in relazione agli obblighi di diligenza e controllo richiamati dalla Legge 132/2025;

- l’assegnazione chiara di ruoli e responsabilità lungo la catena del valore;

- l’integrazione dei requisiti regolatori nei processi decisionali e operativi esistenti.

Sinergie, queste, che risultano particolarmente evidenti per le organizzazioni complesse o multisettoriali, chiamate a gestire portafogli eterogenei di soluzioni AI e a dimostrare, anche verso l’esterno (secondo una prospettiva inside-out), un approccio strutturato e credibile alla governance dell’AI.

A nostro avviso, il rapporto tra AIMS e AI-Act non va interpretato in termini di alternativa o sovrapposizione, ma come un delicato e funzionale equilibrio tra conformità normativa e maturità organizzativa. Se il Regolamento Europeo rappresenta un punto di arrivo imprescindibile sul piano giuridico, l’AIMS può essere visto come uno strumento di accompagnamento strategico, in grado di trasformare l’obbligo regolatorio in un’opportunità di consolidamento dei processi, di rafforzamento della fiducia e di creazione di valore nel medio-lungo periodo.

È proprio in questa capacità di andare “oltre la compliance” che risiede, probabilmente, uno dei principali elementi di interesse della ISO/IEC 42001 nel panorama emergente della regolazione dell’AI.

In tale prospettiva, sarà cruciale capire come la ISO/IEC 42001 e il relativo ecosistema ISO/IEC a supporto, andranno a convivere con la serie di norme elaborate dagli organismi di normazione europei CEN e CENELEC a supporto del’AI-Act. Si tratta di circa una decina di norme, elaborate dal Comitato Tecnico CEN/CLC JTC 21 “Artificial Intelligence“[1] e attese in massima parte nella seconda metà del 2026, ma soprattutto candidate ad essere armonizzate al Regolamento Europeo[2]. Tra di esse spicca il progetto prEN 18286, Artificial intelligence – Quality management system for EU AI Act regulatory purposes, norma pensata per essere interoperabile con l’AIMS e che sarà oggetto di futuri approfondimenti su InGruppo.

Conclusioni

L’AIMS non è solo un sistema di gestione di “ultima generazione”, rappresenta al contempo:

- una “nuova frontiera” della normazione, in quanto primo MSSs espressamente pensato per una gestione etica e responsabile di una tecnologia abilitante, nonché milestone di un più ampio ecosistema);

- uno strumento chiave per rispondere alle ambizioni del legislatore europeo (ma non solo) in materia, alla luce della peculiarità e pervasività della tecnologia in esame e dell’insieme di rischi correlati.

Come abbiamo cercato di dimostrare, la ISO/IEC 42001 rappresenta solo il primo necessario passo all’interno di un percorso più ampio e in continuo divenire. Un percorso che chiama in causa altri elementi e riferimenti, verticalità e approfondimenti, competenze e comportamenti, ma soprattutto la volontà di mettersi in gioco e di raccogliere la sfida lanciata dall’AI.

[1] Per maggiori informazioni: https://www.cencenelec.eu/areas-of-work/cen-cenelec-topics/artificial-intelligence

[2] Le norme in questione sono state espressamente richieste dalla Commissione Europea attraverso un’apposita, formale “Richiesta di Normazione” (Standardization Request), i.e. Comunicazione C(2023) 3215 (M/593), recentemente aggiornata come C(2025) 3871 (M/613) . Per maggiori informazioni: https://ec.europa.eu/growth/tools-databases/enorm/mandate/613_en