a cura di

Francesco Spadera, Project Manager, Consulente, Formatore Twin Transition

Marco Cibien, ICIM Consulting

Il contesto, le sfide, la norma

L’ultimo decennio del Nuovo Millennio è stato indubitabilmente segnato dal consolidamento della trasformazione digitale, il “lato blu” della Twin Transition, che ha investito in modo trasversale tutti i settori della società e dell’economia. Dalla digitalizzazione di prodotti e servizi alla diffusione dei sistemi cyber-fisici, dalle smart technologies all’Internet of Things (IoT), un insieme articolato di nuove tecnologie abilitanti (KETs – Key Enabling Technologies) ha profondamente trasformato il nostro modo di vivere e di lavorare. Tra queste, una si è affermata – e si sta sempre più affermando – come indiscussa “regina”: l’Intelligenza Artificiale (AI – Artificial Intelligence).

Benché le radici storiche dell’AI siano tutt’altro che recenti[1] e il suo sviluppo sia stato caratterizzato da ciclici periodi di entusiasmo e disillusione – le “estati e inverni”[2] dell’AI – sembra proprio che questo Secolo possa essere ricordato come quello della sua piena maturazione. L’avvento dei Modelli Linguistici di Grandi Dimensioni (LLM – Large Language Models) ha infatti reso disponibili, per la prima volta nella storia e su larga scala, sistemi capaci di condividere con noi Sapiens due caratteristiche peculiari, tutt’altro che banali: il ragionamento e il dialogo.

Il potenziale e la pervasività dell’AI hanno spostato l’attenzione ben oltre la sola dimensione tecnica, portando in primo piano questioni legate alla responsabilità, all’etica e alla governance. Temi certamente determinati dalla natura stessa dell’AI come nuova forma di “intelligenza” e di potenziale “agente” – capace di incidere su decisioni, processi e comportamenti – che hanno innescato una continua rincorsa tra legislazione, normazione tecnico-volontaria e gli incessanti sviluppi tecnologici.

In questo articolo ci soffermeremo su un recente strumento tecnico-normativo sviluppato espressamente per promuovere una gestione etica e responsabilità dei “sistemi AI”[3]: la ISO/IEC 42001:2023[4], prima norma internazionale a definire un insieme di requisiti (certificabili) per un sistema di gestione dell’AI (AIMS – AI Management System). A seguire, ne analizzeremo l’impostazione, le finalità e le principali implicazioni, soffermandoci anche sul suo non semplice rapporto con il discusso AI-Act europeo[5] e con la nostra Legge 132/2025[6] in materia.

AIMS: la genesi e le affinità

La ISO/IEC 42001 è stata elaborata sotto la competenza del Comitato Tecnico internazionale ISO/IEC JTC 1 “Information technology“[7], un vero e proprio “standardization hub” per tutto ciò riguarda l’IT in senso lato. Basti pensare che le norme pubblicate sfiorano quota 3700, mentre i progetti attualmente in fase di sviluppo sono oltre 550. Il JTC 1, per gestire questa immensa mole di lavori è (prevalentemente) organizzato in Sotto-Commissioni; nello specifico, il tema dell’AI è allocato presso la omonima SC 42[8]. Se non stupisce che sia la segreteria del TC sia della SC siano a guida statunitense (ANSI), è forse più curioso notare come il primo stia per giungere la soglia dei 40 anni di anzianità, mentre la seconda sia attiva da poco meno di un decennio, 2017 per la precisione. Anno in cui ChatGPT o Gemini erano ancora in stato embrionale, a testimonianza della consistente evoluzione avuta dalla normazione in risposta alla sfide socio-tecniche contemporanee.

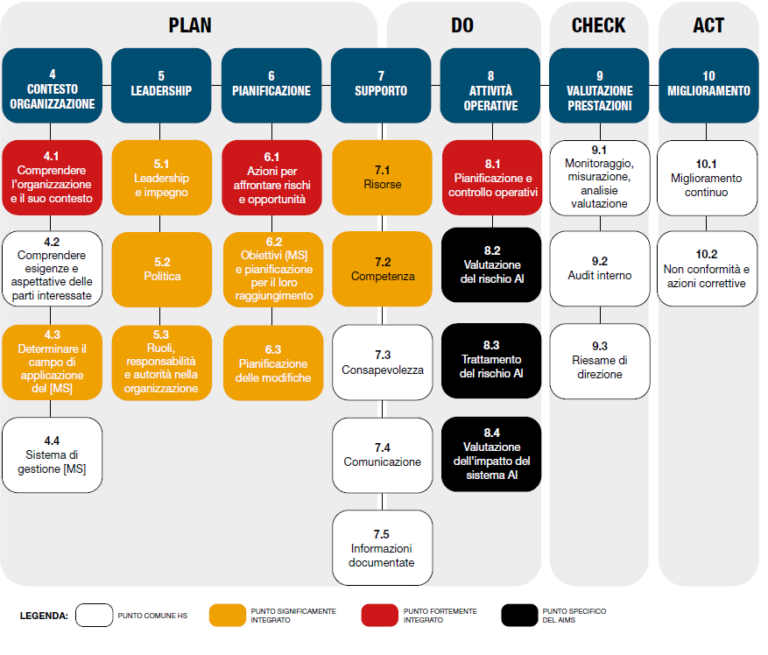

L’AIMS presenta la struttura tipica dei sistemi di gestione (MS(s) – Management System(s)) ISO di “ultima generazione”, ossia basati sulla cosiddetta Harmonized Structure[9] (HS; cfr. Fig.1).

Figura 1 – La struttura della ISO/IEC 42001 (AIMS)

Si tratta pertanto di un sistema per sua stessa natura adattivo, scalabile e facilmente integrabile con gli ISO MSs riferibili ad altre discipline di management. Tra questi ultimi spicca – manco a dirlo – la ISO/IEC 27001, ossia l’ISMS – Information Security MS. Anche tale norma ricade sotto la competenza di JTC 1, nella fattispecie la “storica” (correva l’anno 1989!) SC 27[10], Information security, cybersecurity and privacy protection, giunta alla sua terza edizione (2022); si tratta inoltre di una delle norme di sistemi di gestione (MSS – Management System Standard (s)) tra le più rilevanti (per via del tema trattato e per la crescente attenzione verso la cybersecurity), tra le più “paradigmatiche” (come vedremo, a breve, nel seguito), nonché tra le più certificate (come sancisce il recente ISO Survey 2024[11]).

L’AIMS condivide in effetti con l’ISMS alcuni aspetti ed elementi strutturali degni di nota, come conseguenza della comune matrice JTC 1. Porremo la nostra attenzione su 3 di questi, tra loro correlati, ossia:

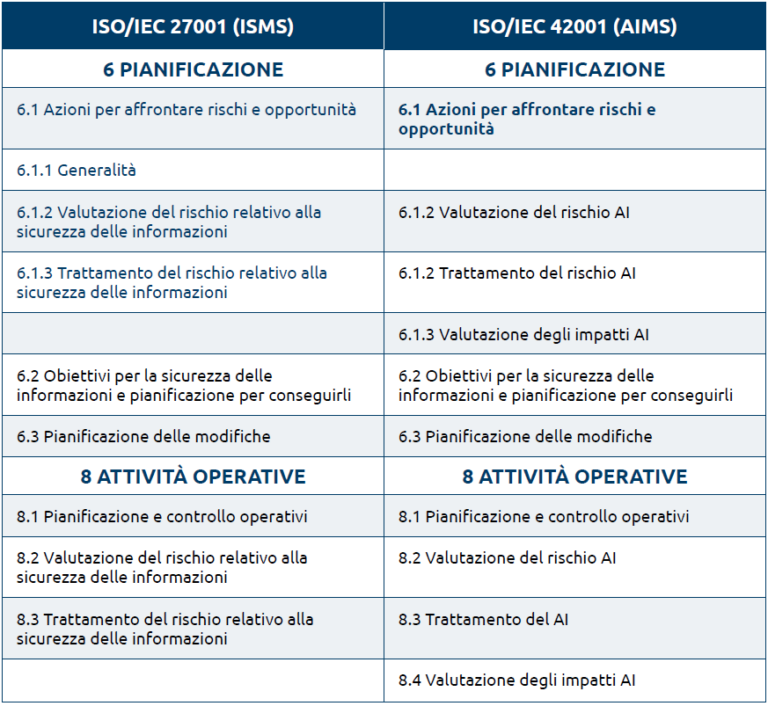

- Gestione del rischio (risk-management): in entrambe le norme i punti 6 (pianificazione) e 8 (attività operative) sono caratterizzati da un consistente potenziamento dei requisiti relativi alle “azioni per affrontare rischi e opportunità” (punti 6.1, 8.2 e 8.3) che vengono (vedere Prospetto 2) potenziati da specifici processi di valutazione del rischio (risk assessment) e trattamento del rischio (risk treatment);

Prospetto 2 – Struttura dei punti 6 e 8 nelle norme ISO/IEC 27001 e ISO/IEC 42001

- (logica per) Controlli: entrambe le norme prevedono un’Appendice A (normativa) che dettaglia un insieme di controlli di base (ossia delle specifiche misure di trattamento del rischio) che le organizzazioni sono tenute ad attuare per affrontare delle tipiche fonti di rischio. Da notare che:

- l’ISMS prevede un totale di 93 controlli a fronte dei 38 previsti dall’AIMS;

- mentre l’ISMS dispone di una norma specifica di supporto, ossia la ISO/IEC 27002[12], l’AIMS abbina alla sopra citata Appendice A, una seconda Appendice B, sempre normativa, che fornisce una guida applicativa ai controlli stessi;

- in entrambi i casi, i controlli di base non esauriscono il perimetro delle misure adottabili: le organizzazioni possono (per non dire devono) integrarli con controlli aggiuntivi, definiti sulla base del proprio contesto organizzativo, delle specifiche fonti e tipologie di rischio e delle esigenze operative e strategiche;

- in entrambi i casi, i controlli sono focalizzati sul solo down-side del rischio, concentrandosi cioè sulla mitigazione degli impatti negativi e non sulla valorizzazione delle opportunità.

- Dichiarazione di applicabilità (SoA – Statement of Applicability): entrambe le norme richiedono all’organizzazioni di predisporre un documento che elenchi i controlli attuati e una motivazione esplicita per ogni eventuale esclusione dei controlli di base. Tale dichiarazione costituisce una delle principali evidenze documentali a scopo di certificazione.

Data per acquisita tale “affinità elettiva”, ci sono altri aspetti peculiari dell’AIMS, non meno rilevanti, che è opportuno indagare.

[1] Il termine “intelligenza artificiale” è stato introdotto nel 1955 alla conferenza di Dartmouth, grazie al contributo di J. McCarthy, M.L Minsky, N. Rochester, C.E. Shannon, benché i prodromi siano riferibili ai fondamentali lavori di A. Turing, culminati con il paper del 1950 “Computing Machinery and Intelligence”. È però opportuno ricordare che le “reti neurali artificiali” (ANN – Artificial Neural Network) erano state introdotte già nel 1943 con il celebre paper di W.S. McCulloch e W. Pitts “A Logical Calculus of the Ideas Immanent in Nervous Activity”.

[2] Il riferimento è ad alcuni corsi e ricorsi storici nei quali la AI ha dapprima goduto di una certa popolarità per poi essere provvisoriamente accantonata in favore di altre tecnologie emergenti. Si pensi, ad esempio, all’hype iniziale risalente agli Anni ’60 e ’70 per le reti neurali, o ancora alla clamorosa vincita di Deep-Blue di IBM al gioco degli scacchi contro il campione russo G.K. Kasparov del 1996, alle quali hanno fatto seguito dei periodi di minor interesse applicativo verso queste prime soluzioni AI-based.

[3] Nella ISO/IEC 22989:2023 (= UNI CEI EN ISO/IEC 22989:2023), Information technology – Artificial intelligence – Artificial intelligence concepts and terminology, il termine “Sistema AI (AI system)” è definito come “sistema ingegnerizzato che genera output quali contenuti, previsioni, raccomandazioni o decisioni a fronte di un dato insieme di obiettivi definiti dall’uomo”.

[4] Norma adottata a livello nazionale come: UNI CEI ISO/IEC 42001:2024, Tecnologie informatiche – Intelligenza artificiale – Sistema di gestione.

[5] Regolamento (UE) 2024/1689, del Parlamento Europeo e del Cconsiglio del 13 giugno 2024, che stabilisce regole armonizzate sull’intelligenza artificiale e modifica i regolamenti (CE) n, 300/2008, (UE) n, 167/2013, (UE) n, 168/2013, (UE) 2018/858, (UE) 2018/1139 e (UE) 2019/2144 e le direttive 2014/90/UE, (UE) 2016/797 e (UE) 2020/1828 (regolamento sull’intelligenza artificiale

[6] Legge 23 settembre 2025, n. 132, Disposizioni e deleghe al Governo in materia di intelligenza artificiale.

[7] Per maggiori informazioni: https://www.iso.org/committee/45020.html; https://jtc1info.org

[8] Per maggiori informazioni: https://www.iso.org/committee/6794475.html

[9] Si tratta del modello comune a tutte le norme ISO di sistemi di gestione (e.g. ISO 9001, ISO 14001, ISO 45001), per le quali stabilisce una base terminologica (20 termini e definizioni) e strutturale (7 punti norma, comprensivi di titoli e parti di testo comuni). Di fatto una “meta-norma”, introdotta nel 2012 come HLS – High Level Structure e rivista (light review) nel 2021, che ha introdotto un nuovo modo di elaborare, intendere e applicare i sistemi di gestione di matrice ISO.

Per maggiori informazioni: https://www.iso.org/management-system-standards.html ; https://committee.iso.org/home/jtcg

[10] Per maggior informazioni: https://www.iso.org/committee/45306.html; https://committee.iso.org/home/jtc1sc27

[11] Si tratta di una indagine globale, liberamente accessibile, condotta da ISO e IAF – Internation Acceditation Forum, secondo la quale la ISO/IEC 27001 si piazza al 4° posto (dietro al classico trittico qualità (ISO 9001) – ambiente (ISO 14001) – sicurezza (ISO 45001)), essendo prossima ai 100.000 certificati (di cui 3284 in Italia) a copertura di circa 180.000 siti (5924 in Italia).Per maggiori informazioni: https://www.iso.org/the-iso-survey.html

[12] Norma adottata a livello nazionale come: UNI CEI EN ISO/IEC 27002:2023, Sicurezza delle informazioni, cybersecurity e protezione della privacy – Controlli di sicurezza delle informazioni